Per svolgere meglio i propri compiti, i sistemi TVCC possono sfruttare l’AI e i suoi algoritmi di machine learning, che affiancano (senza sostituirlo) l’intervento umano per analizzare con precisione ogni singola scena, individuare comportamenti pericolosi, illeciti o sospetti, prevenire furti e altri crimini.

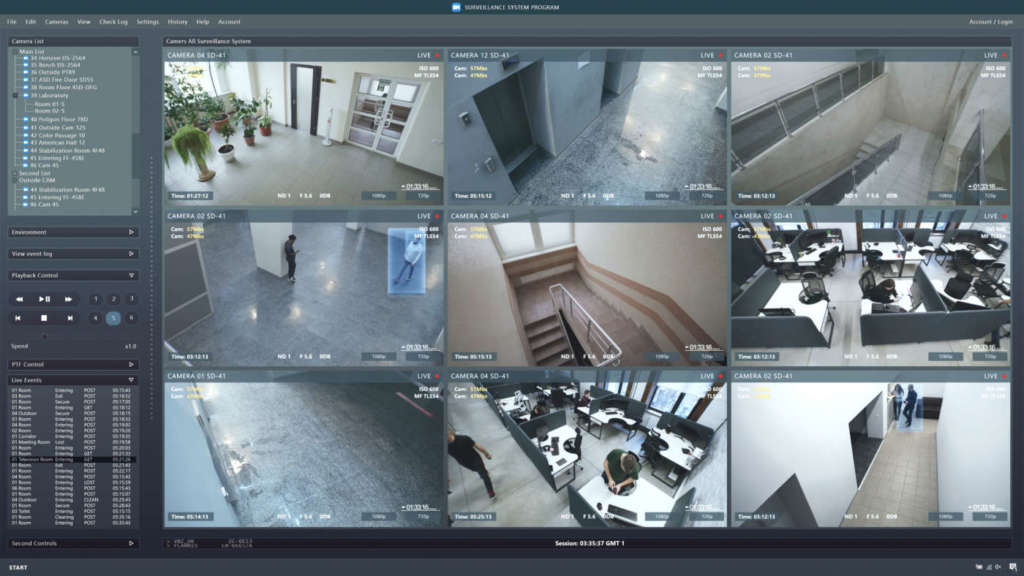

Nel corso degli ultimi anni, le tecnologie legate alla videosorveglianza hanno compiuto passi da gigante nel monitoraggio H24 di ambienti, persone e oggetti allo scopo di impedire (e scoraggiare) furti, vandalismi e altri crimini. Dall’analisi “umana” delle riprese analogiche, con lavoratori addetti alla ricerca di comportamenti sospetti sia live sia dopo l’evento criminoso, si è passati all’analisi video automatizzata, che solleva l’operatore di videosorveglianza dai compiti più gravosi (e noiosi) per concentrarsi su cose molto più importanti che richiedono esperienza e capacità decisionali.

Le telecamere di videosorveglianza di nuova generazione possono già svolgere autonomamente compiti di “analisi preventiva” in modo più o meno accurato a seconda della loro potenza di calcolo, ma i migliori risultati si ottengono quando l’intero sistema (moduli software, VMS, NVR ecc.) è “intelligente” e addestrato ad analizzare le riprese.

Perché l’intelligenza artificiale è così importante nei sistemi di sicurezza

L’analisi video basata sull’AI (intelligenza artificiale) è un elemento chiave nell’evoluzione della videosorveglianza: permette di velocizzare l’analisi dei dati e automatizzare operazioni ripetitive, come per esempio la ricerca delle targhe in un database o dei lineamenti di una persona. Non può invece, almeno per il momento, sostituirsi all’esperienza dell’uomo e alle sue capacità decisionali.

La vera forza dell’analisi AI sta quindi nella combinazione tra i due metodi, sfruttando le soluzioni AI per aumentare l’efficienza di un operatore e ridurre i margini di errore. In futuro, grazie all’aumento esponenziale della capacità di calcolo, della qualità video e, soprattutto, all’auto-apprendimento, l’AI potrà anche sostituirsi all’operatore, svolgendo molte più funzioni in meno tempo e con un grado di accuratezza e affidabilità maggiore, anche in ambito decisionale.

Machine learning e deep learning

Il concetto di intelligenza artificiale comprende gli algoritmi di machine learning e deep learning. Entrambi costruiscono automaticamente un modello matematico che utilizza una gran quantità di dati campione (dati di addestramento) così che il sistema possa imparare a calcolare i risultati senza una specifica programmazione.

È proprio questo l’aspetto fondamentale dell’AI applicata alla videosorveglianza: nessuna scena inquadrata è simile a un’altra, cioè non esiste uno scenario “standard” da utilizzare come base per rilevare e anticipare comportamenti sospetti o pericolosi. L’analisi in tempo reale dell’AI con auto-apprendimento consente quindi di perfezionare costantemente il rilevamento e renderlo il più simile possibile a quello “umano”, che si basa sull’esperienza e sull’intelligenza.

Un algoritmo AI viene sviluppato mediante un processo iterativo: si ripete un ciclo di raccolta ed etichettatura dei dati di addestramento, per poi procedere al loro utilizzo per addestrare l’algoritmo e testarlo fino a raggiungere il livello qualitativo desiderato.

Visione artificiale e algoritmi

Nell’ambito della videosorveglianza, si parla di “visione artificiale” quando un computer analizza una scena (video e immagini), che sia in tempo reale oppure registrata. La visione artificiale ottenuta con la programmazione tradizionale si basa su metodi che calcolano le caratteristiche di un’immagine, definite manualmente dallo sviluppatore di un algoritmo che conosce bene gli elementi importanti di una ripresa.

Gli algoritmi di machine learning costruiscono invece automaticamente un modello matematico utilizzando grandi quantità di dati campione: le caratteristiche vengono comunque definite manualmente, ma il modo di combinarle viene imparato dall’algoritmo mediante l’esposizione a grandi quantità di dati di addestramento etichettati (annotati). In un’applicazione di machine learning, è quindi necessario addestrare il computer a ottenere il programma desiderato: i dati vengono raccolti e annotati dall’uomo, inseriti nel sistema e il processo continua fino a quando l’applicazione impara a sufficienza per rilevare ciò che si desidera identificare, per esempio uno specifico tipo di veicolo (berlina, SUV, station wagon, furgone ecc.), i lineamenti e le caratteristiche di una figura umana (altezza, corporatura ecc.), l’abbigliamento, gli accessori come borse o zaini ecc.

Il deep learning è una versione avanzata del machine learning: sia l’estrazione delle caratteristiche sia la loro combinazione in strutture profonde di regole per produrre un output vengono apprese dai dati. L’algoritmo può definire automaticamente le caratteristiche da cercare nei dati di addestramento e apprendere strutture molto profonde di combinazioni di caratteristiche concatenate. Il nucleo degli algoritmi di deep learning si ispira al funzionamento dei neuroni del cervello umano, che forma una conoscenza di livello superiore combinando gli output dei neuroni in una gerarchia profonda (rete) di regole concatenate.

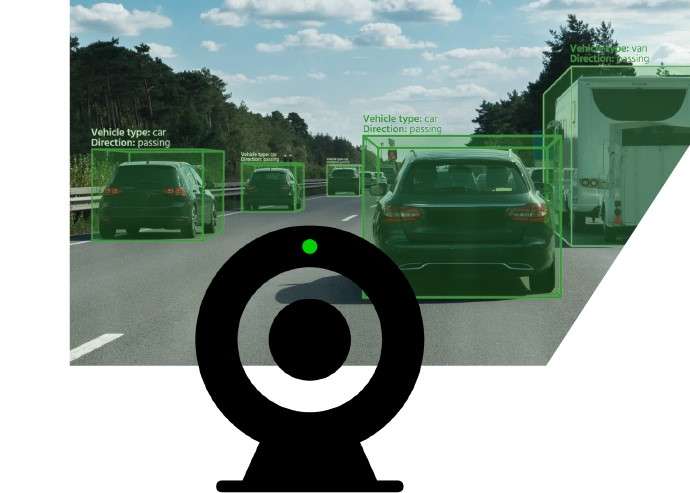

Grazie agli algoritmi di deep learning (come le reti neurali artificiali che si ispirano al cervello umano), è possibile creare rilevatori ottici evoluti e addestrarli automaticamente a individuare oggetti molto complessi, anche se in posizioni differenti da quelle iniziali e in contesti critici (controluce, scarsa luminosità, altri disturbi ambientali ecc.). Un rilevamento basato su deep learning può, per esempio, rilevare non solo i veicoli ma anche classificarli per tipo, marca e modello, da prospettive differenti e indipendentemente dalle condizioni ambientali presenti sulla scena.

Nonostante la netta superiorità (ma anche complessità) del deep learning, per le specifiche analitiche della videosorveglianza è quasi sempre sufficiente un algoritmo di machine learning classico, dedicato e ottimizzato.

Raccolta, annotazione dei dati e addestramento

Per sviluppare un’applicazione analitica di videosorveglianza basata su AI, è necessario raccogliere grandi quantità di dati, ovvero immagini e video di persone, veicoli o altri elementi ripresi dalle telecamere che possono risultare d’interesse per l’analisi. Tutti gli elementi pertinenti devono essere categorizzati ed etichettati attraverso un lavoro manuale lungo e impegnativo.

L’addestramento (apprendimento) è la fase in cui il modello riceve i dati annotati, utilizzando un’architettura logica di supporto per modificarsi e migliorarsi ciclicamente fino a ottenere la qualità desiderata, cioè a essere ottimizzato per svolgere il compito prestabilito. L’apprendimento nell’ambito della videosorveglianza viene eseguito con metodo supervisionato, cioè basato su esempi. I dati di input sono già abbinati ai risultati di output desiderati (annotati) e le prestazioni dell’algoritmo addestrato dipendono direttamente dalla quantità e dalla qualità dei dati di addestramento. L’importante è utilizzare un set di dati che rappresenti tutti i potenziali dati di input in una situazione di utilizzo reale.

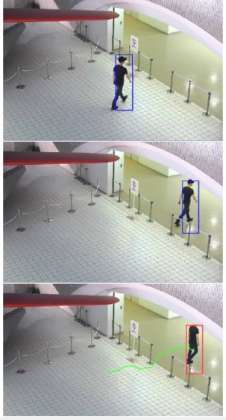

Nel caso dei rilevatori di oggetti, lo sviluppatore deve sempre addestrare l’algoritmo con un’ampia varietà di immagini e con diversi esempi di oggetti, orientamenti, dimensioni, condizioni di illuminazione e sfondi. Solo se i dati di addestramento sono rappresentativi per il caso d’uso previsto, l’applicazione analitica finale sarà in grado di effettuare previsioni accurate anche quando elaborerà dati nuovi, cioè mai rilevati durante la fase di addestramento. L’analisi video basata sull’AI può fornire un valido aiuto nel discriminare le situazioni che si presentano, ignorando quelle meno importanti (come una persona che cammina lungo un corridoio di un museo, per esempio) ed evidenziando invece quelle potenzialmente pericolose (la stessa persona che si avvicina a un quadro o a una scultura).

Più gli algoritmi di machine learning sono efficaci, auto-apprendenti e allenati, minori saranno i falsi allarmi e le notifiche all’operatore del centro di controllo o al sistema di back-end. Le applicazioni di analisi video che migliorano le prestazioni e l’efficacia di un impianto di videosorveglianza sono molteplici.

Si parte dalla Motion Detection, sia in versione “base” sia in versione “AI”, per arrivare a soluzioni più efficaci e complesse come l’Intruder Detection, la Tripwire e la Cross Line Detection, che rilevano le persone o gli oggetti in movimento all’interno di un ambiente il cui perimetro virtuale è stato precedentemente definito. L’allarme può essere causato dal superamento del perimetro o di una linea virtuale, sia in entrata che in uscita, oppure da movimenti all’interno dell’area, con analisi AI del tipo di movimento, soggetto e oggetto. È efficace nel monitoraggio di varchi d’ingresso, parcheggi, corsie riservate, aree di sosta vietata o limitate a particolari attività (per esempio, scarico merci), aree museali interdette al pubblico ecc.

Per garantire la sicurezza in aree critiche (musei, aeroporti e piazze pubbliche) spesso affollate e a rischio furti, vandalismi o atti terroristici, si utilizzano le applicazioni di Abandoned Object e Missing Object. Entrambe riconoscono e rilevano gli oggetti abbandonati o lasciati incustoditi (come una borsa che potrebbe contenere un ordigno) e quelli rimossi per un furto (per esempio, il quadro di un museo oppure il rilevatore di un sistema antintrusione), confrontando la stessa inquadratura in tempi differenti e calcolando il tempo di permanenza (o di assenza) dell’elemento nella scena. Le stesse applicazioni permettono di monitorare strumenti e oggetti pericolosi anche in aree lavorative, magazzini ecc.

Altre applicazioni che si rivelano efficaci nei confronti dei furti e dei vandalismi sono la Loitering Detection e la Stationary Vehicle Detection: rilevano e segnalano la presenza di persone e veicoli fermi in un’area virtuale (come per esempio uno sportello bancomat o un marciapiede) oltre il tempo predefinito, che è spesso sintomo di un appostamento, di un tentativo di intrusione o di un’occupazione abusiva per attività illecite.

L’applicazione di Direction Detection può essere utilizzata sia per scopi di sicurezza sia per la verifica dei flussi di traffico su strade pubbliche, percorsi privati e all’interno di parcheggi: rileva persone e veicoli che percorrono le aree predefinite seguendo una direzione opposta rispetto a quella indicata. La combinazione di queste applicazioni arricchite dall’AI può anche supportare le indagini forensi, raggruppando in modo efficiente i dati video e rintracciando il percorso di una persona o un veicolo, identificandone la posizione precedente e l’ultima posizione nota.

Qualità video, illuminazione e posizione delle telecamere

La risoluzione delle immagini, il posizionamento delle telecamere e le condizioni di illuminazione ambientale sono solo alcuni dei fattori che determinano l’utilizzabilità “effettiva” di una ripresa per l’analisi video con AI. Un altro elemento rilevante a questo proposito è anche il caso d’uso: un video che sembra di buona qualità agli occhi di un operatore potrebbe non avere una qualità ottimale per le prestazioni di un’applicazione video-analitica.

Alcune tecnologie di elaborazione dell’immagine come NR, WDR e auto IRIS possono risultare controproducenti in fase di analisi. I sistemi di illuminazione IR sono utili per distinguere persone, oggetti e movimenti al buio, ma risultano meno efficaci rispetto a un’adeguata illuminazione ambientale quando le condizioni meteo si fanno critiche (pioggia, neve, nebbia) e gli infrarossi colpiscono direttamente uno o più elementi della scena impedendo una corretta analisi.

Distanza di rilevamento e velocità di movimento sono altrettanto importanti per l’analisi video con AI. L’applicazione deve poter “vedere” bene l’oggetto e per un periodo sufficientemente lungo. La durata di tale periodo dipende dalle capacità di elaborazione della piattaforma (frame rate): minori sono le capacità di elaborazione, più l’oggetto deve essere visibile per poter essere rilevato. Se il tempo di esposizione della telecamera non è idoneo alla velocità dell’oggetto, anche la sfocatura da movimento che appare sull’immagine può ridurre la precisione di rilevamento.

In genere una telecamera con risoluzione molto elevata non assicura una maggiore distanza di rilevamento, mentre le capacità di calcolo necessarie per eseguire un algoritmo di machine learning sono proporzionali alle dimensioni dei dati di input (per esempio, quattro volte per la risoluzione 4K rispetto al Full HD). Per via delle limitate capacità di calcolo di molte telecamere, è consigliabile eseguire le applicazioni AI a una risoluzione inferiore rispetto a quella nativa oppure limitandosi a una porzione dell’immagine (crop).